El filósofo Mark Coeckelbergh pide regular cuanto antes la IA para proteger la democracia

02 junio, 2024

Luis Lidón

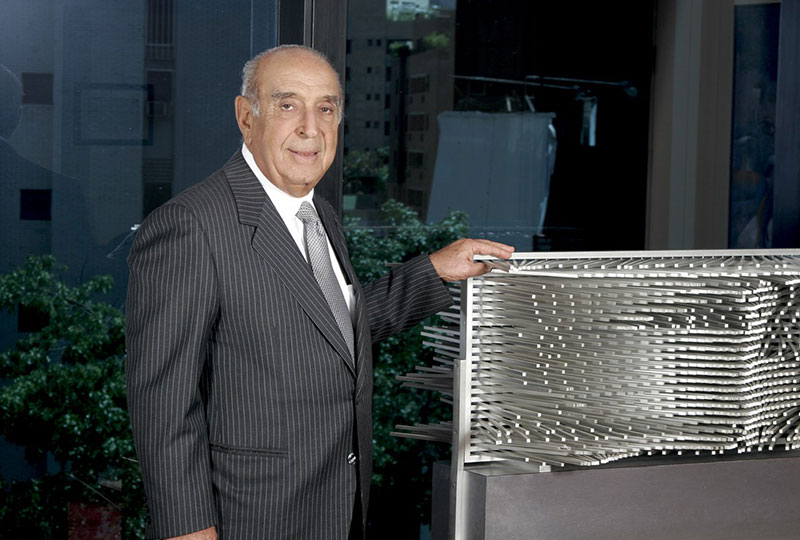

Viena, 2 jun (EFE).- El filósofo belga Mark Coeckelbergh es uno de los grandes pioneros en la reflexión crítica sobre la Inteligencia Artificial (IA), una tecnología que -advierte- debe regularse «antes de que sea tarde» porque puede socavar las bases de la democracia.

Coeckelbergh, profesor en la Universidad de Viena, publicó recientemente «Why AI Undermines Democracy» («Por qué la IA socava la democracia»), que será traducido al español por la editorial Cátedra, que ha editado otros tres libros de referencia del filósofo.

«Creo que debemos apresurarnos en hacer cambios porque las tendencias en cuanto a la democracia no pintan bien», explica a EFE Coeckelbergh en su despacho de la Universidad de Viena.

En un año repleto de importantes elecciones globales, como las de India, el Parlamento Europeo del 6 al 9 de junio y las de Estados Unidos en noviembre, existe una urgente necesidad de regular la IA para evitar posibles manipulaciones.

«El principal riesgo es que el sistema de representación que tenemos no sea efectivo si hay demasiada manipulación», aclara el filósofo.

Coeckelbergh recuerda que la tecnología tiene una capacidad enorme para influir en las elecciones, como ya demostró el escándalo de Cambridge Analytica en los comicios estadounidenses de 2016 en los que resultó vencedor Donald Trump.

«Hay un verdadero peligro de manipulación. Hemos visto casos como el de Cambridge Analytica donde se realizaron perfiles individuales para manipular votos de manera muy específica», detalla el filósofo.

«Siempre hubo propaganda, pero ahora se apunta a individuos concretos basándose en sus propios datos», añade.

El profesor belga subraya que la educación y la regulación son esenciales. Y aunque considera que la Unión Europea (UE) ha marcado el camino al legislar sobre el derecho a la privacidad y el uso de la IA, estas normas todavía son insuficientes.

Una regulación global de la IA

La IA puede ser empleada para reforzar la vigilancia de los ciudadanos y manipular su comportamiento, lo que representa un desafío para la democracia.

Esa amenaza va en dos direcciones: puede fortalecer a regímenes autoritarios que quieren socavar la democracia y favorece a las fuerzas populistas y extremistas que quieren acabar desde dentro con el Estado de derecho.

«El mayor peligro es que el populismo utilice estos métodos para tener más votos y luego tome medidas antidemocráticas», resume. Y agrega: «La desinformación puede conducir al totalitarismo».

Y dado que esta amenaza es mundial debería de existir «una gobernanza global de la IA porque esta tecnología no se detiene en las fronteras nacionales».

Sin una regulación global, existe el riesgo de que las grandes corporaciones exploten a los países menos poderosos para seguir con sus prácticas.

La deshumanización de las decisiones automáticas

«La IA puede fortalecer una forma de tratar a las personas de manera burocrática, donde ya no vemos personas sino solo números», advierte.

Es fundamental que las decisiones importantes, subraya Coeckelbergh, especialmente aquellas que afectan a vidas humanas, sean tomadas por personas y no por máquinas en procesos automatizados.

Y esta situación no afecta sólo a escenarios bélicos, con la IA seleccionando objetivos, -algo de lo que se ha acusado a Israel en Gaza-, sino sobre todo en aspectos menos obvios, como el uso de esa tecnología a la hora de gestionar el acceso a ayudas sociales.

Si la IA mantiene ciertos sesgos o los algoritmos actúan de forma opaca se pueden romper principios constitucionales como la igualdad. Y, según recalca Coeckelbergh, suelen ser las personas más vulnerables las más perjudicadas.

El filósofo no encuentra ningún problema en que la tecnología asista en la toma de decisiones, pero critica que ahora «las decisiones se externalizan directamente a las máquinas».

«No estoy en contra del desarrollo tecnológico, pero deberíamos aprovechar los beneficios de la tecnología de manera ética y políticamente responsable», afirma el experto.

La tecnología no es neutral

Coeckelbergh recalca que «la tecnología no es neutral», ya que las grandes empresas de Silicon Valley promueven en su uso una «ideología libertaria» que aboga por la mínima intervención estatal y que resulta «destructiva para el bien común y la democracia».

Por eso, asegura, la propia regulación del sector no es suficiente, debe de existir un fuerte marco externo para que el desarrollo de la IA no esté guiado sólo por intereses comerciales o ideológicos de un pequeño grupo de empresas.

«Si hacemos que la tecnología sea más democrática aseguramos que otros valores y otras visiones también influyan en el sistema», señala.

De esa forma se podría contrarrestar ciertas tendencias de la IA y los algoritmos de las redes a favorecer ideologías extremistas y una creciente polarización.

Coeckelbergh ve con mucha preocupación el enorme poder de personas como Elon Musk, dueño de la red social X, ya que sus decisiones en esa red social ha favorecido a la extrema derecha.

«El poder de estas personas es realmente enorme. Necesitamos limitar ese poder para asegurar que las grandes decisiones sobre nuestro futuro tecnológico se tomen de manera democrática», concluye. EFE

ll/wr/jac